Apple Books запустила функцію автоматичного озвучення книжок за допомогою набору голосів. А голос Стівена Фрая, який озвучив серію книжок про Гаррі Поттера, клонували саме з аудіокнижок про юного чарівника. Щобільше — ШІ-версії голосів відомих людей без їх згоди використовують для озвучення расистських та жорстоких висловлювань.

Аллегра Кларк — акторка, яка озвучила десятки реклам і віддала свій голос понад 100 персонажам відеоігор, зокрема — в аніме-відеогрі Beidou. Одного разу вона побачила Beidou у дещо відвертому відео в TikTok, але героїня говорила те, що сама Кларк для неї ніколи не записувала. Виявилося, автор відео клонував голос Кларк за допомогою ШІ-інструменту американської компанії-виробника програмного забезпечення ElevenLabs і «змусив» її казати те, що йому хотілося.

Акторка озвучення каже, що це може призвести до проблем із її клієнтом, який може сприйняти такий здавалося б жарт за порушення умов контракту. Кларк розповіла, що написала листа розробникам інструменту, в якому попросила видалити «її» аудіофайл і у майбутньому не клонувати її голос.

Втім ElevenLabs написала, що ще не визначила, чи насправді те відео було створено із застосуванням її технології. Компанія відписала, що вживе негайних заходів, лише якщо в аудіофайлі були «ненависницькі тези чи наклеп», і що вона не відповідальна за порушення копірайту. Після цього одного листа від ElevenLabs більше не було нічого чутно і компанія не вжила ніяких заходів.

«Це неправильно, що у нас немає права власності на наші власні голоси», — обурюється Кларк Forbes.

Forbes звернувся за коментарем щодо цієї ситуації до співзасновника і гендиректора ElevenLabs Матеуш Станішевського. Той у листі сказав, що користувачам потрібна «пряма згода» людини на клонування її голосу, якщо клоновану версію використають у «шкідливому чи наклепницькому» контенті.

За кілька місяців після інциденту із Кларк компанія запустила «голосову капчу»: людина, яка хоче скористатися інструментом клонування, повинна озвучити обране випадковим чином слово і цей голос повинен збігатися із тим, який хочуть клонувати.

ElevenLabs — це одна із найгарячіших ШІ-компаній, яку оцінюють у близько $100 млн і підтримують Andreessen Horowitz та співзасновник Google DeepMind Мустафа Сулейман. Інструменту компанії потрібне аудіо довжиною від 30 секунд до 10 хвилин, щоб відтворити майже ідентичний оригіналу голос. ElevenLabs, а також FakeYou і Voice AI, які пропонують безплатну бібліотеку цифрових голосів, знаходяться у центрі проблеми впливу генеративного ШІ на акторів озвучення і дубляжу.

Це неправильно, що у нас немає права власності на наші власні голоси.

Аллегра Кларк, акторка дубляжу і озвучення

Forbes поговорив з акторами та побачив, що ситуація дійсно видається загрозою для їх подальшої роботи. Одна акторка розповіла, що компанія відмовилася продовжувати із неї угоду на озвучення серії книжок за день після того, як підписала угоду про партнерство з ElevenLabs.

Інша акторка сказала, що її роботодавець сказав про використання ШІ замість неї для перезапису невдалих фрагментів — цей процес додатково оплачується. Коли вона сказала, що не хоче, щоб її голос завантажували на будь-який ШІ-сайт, роботодавець погодився, але на перезапис її так і не покликали.

За словами Тіма Фрідландера, президента Національної асоціації акторів дубляжу (NAVA), вони помітили збільшення кількості згенерованих за допомогою ШІ голосів після того, як у січні 2023-го Apple Books запустила функцію автоматичного озвучення книжок за допомогою набору голосів. А британський актор Стівен Фрай, який озвучив серію книжок про Гаррі Поттера, нещодавно розповів, що його голос клонували саме з аудіокнижок про юного чарівника.

Сотні акторів дубляжу та озвучення звернулися до ШІ-генераторів голосу Uberduck і FakeYou.ai, щоб їхні голоси прибрали з баз даних програм. FakeYou.ai й надалі продовжує пропонувати тисячі відомих голосів, а Uberduck у липні прибрав можливість для користувачів завантажувати голоси на платформу.

Джим Каммінгз, який озвучив Вінні Пуха і тасманійського диявола Таза із Looney Tunes, публічно попросив, щоб його голос прибрали із будь-яких голосових генераторів. Він сказав Forbes, що погодиться надати свій голос для подібних програм, якщо йому і його родині будуть виплачувати роялті. «Руки геть від мого голосу», — заявив він.

Юридична дилема

Із законодавчої точки зору, актори дубляжу та озвучення дуже вразливі, адже голос не є інтелектуальною власністю.

У теорії записи голосів акторів, які використовуються із комерційною метою, захищаються «правами на публічність», які не дають експлуатувати зображення/записи відомих людей. Але більшість контрактів, які підписують актори дубляжу, не забороняє використовувати їхні записані голоси для тренування ШІ-систем.

За словами Сіссі Джонс, акторки дубляжу, яка приєдналася до неприбуткової професійної організації NAVA, у всіх контрактах є приблизно одне і те ж формулювання: виробник запису назавжди отримує право власності на нього для користування у наявних технологіях чи тих, які зʼявляться у майбутньому.

Саме тому NAVA разом із акторською профспілкою SAG-AFTRA працюють над тим, щоб прибрати з контрактів формулювання, які дозволяли наймачам використовувати голоси акторів для створення «цифрових двійників» чи «синтезування» за допомогою машинного навчання. Організації вже мають шаблон формулювання для робочих контрактів, який захищає права акторів на власні голоси.

Океан можливостей для зловживання

Багато акторів озвучення стикалися із тим, що фанати чи хейтери використовують ШІ, щоб синтезувати або клонувати їхні голоси для створення насильницького, расистського чи порнографічного контенту. Акторів це непокоїть, адже такі записи можуть почути потенційні роботодавці, яким такі вислови не сподобаються, і вони просто не розглядатимуть кандидата, який «говорить» такі речі.

Була ще одна акторка, Еббі Веффер, яка теж поскаржилася ElevenLabs на те, що за допомогою інструменту компанії зловмисник зробив клон її голосу. Він створив профіль у Twitter з домашньою адресою акторки й поширив расистські і жорстокі висловлювання «її» голосом і від її імені. В ElevenLabs відповіли, що в її випадку не використовувалася їхня програма, а сам інцидент — це частина кампанії, яка спрямована на те, щоб очорнити стартап.

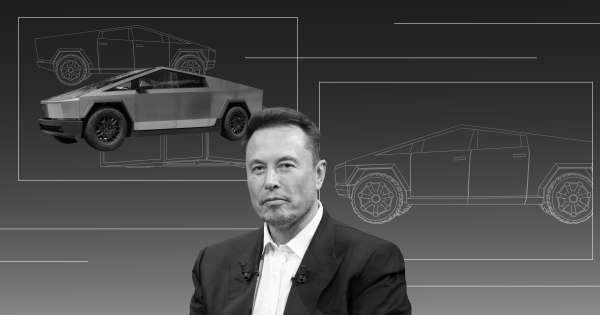

Національна асоціація акторів дубляжу (NAVA) помітила збільшення кількості згенерованих за допомогою ШІ голосів після того, як у січні 2023-го Apple Books запустила функцію автоматичного озвучення книжок за допомогою набору голосів. Фото Зображення згенеровано ШІ Midjourney в співавторстві з Олександрою Карасьовою

Після того, як ElevenLabs запустив бета-версію свого ШІ-інструменту для перетворення тексту на голос у січні, стартап оголосив про проблему зловживання їхньою технологією.

Здатність ШІ дуже точно відтворювати голоси людей також стала можливістю для шахраїв. Цього року Федеральна торгова комісія США оприлюднила попередження про те, що злочинці використовують ШІ-інструменти для імітації голосів, щоб видавати себе за іншу людину і видурювати у її рідних гроші. Один журналіст використав ElevenLabs, щоб створити ШІ-версію свого голосу, за допомогою якої він успішно отримав доступ до свого банківського рахунку.

ElevenLabs не прокоментувала всі зазначені тут випадки, але гендиректор компанії Станішевський написав у листі таке: «Якщо хтось за допомогою нашого інструменту клонує голоси без дозволу власників або із порушенням правил чесного користування, ми заблокуємо такий акаунт і не дамо створити новий за тими ж даними».

На додачу до «голосової капчі» стартап також розробив класифікатор ШІ-голосів, який може сказати із понад 90-відсотковою ймовірністю, чи було створено аудіофайл за допомогою ШІ-інструменту саме ElevenLabs.

Згода і контроль

Збільшення випадків зловживання змушує добросовісні компанії додавати у свої інструменти перевірки, на зразок «голосової капчі» як в ElevenLabs, щоб захистити право людей розпоряджатися власним голосом.

Серед таких компаній Speechify, яка має офіційні ліцензії на голоси деяких знаменитостей, і Resemble AI, яка співпрацює із Netflix і World Bank Group. Зохаіб Ахмед, гендиректор Resemble AI, вважає, що запобігання зловживанню ШІ-інструментами лягає на виробника інструментів, а не на кінцевого споживача. Тому його компанія вимагає аудіозапис згоди на завантаження голосу тим самим голосом, який «заливають» для синтезу чи клонування.

Та бувають такі випадки, коли людина не може дати згоду на використання свого голосу, наприклад якщо актор помер. Актори дубляжу і озвучення були розлючені, коли ігрова студія Hi-Rez Studios додала до своїх контрактів умову, за якою компанія може використовувати клон голосу акторів після їхньої смерті. Скандал в пресі змусив компанію прибрати умову.

Та наразі діячів індустрії найбільше хвилює те, чи є майбутнє в акторів дубляжу та озвучення. Збільшення використання синтезованих голосів змушує їх постійно думати про те, чи знайдуть вони наступну роботу та чи зможуть вони втримати нинішню.

«Для нас дуже важливі контроль за тим, як наші голоси використовують, де саме, а також справедлива компенсація за їх використання», — каже Фрідландер з NAVA.